As cinco capacidades principais do modelo são reveladas, funcionalidade de compreensão de imagem surge misteriosamente: lançamento oficial do o1 está próximo

A OpenAI apresentou no London Developer Day as cinco principais capacidades do modelo o1 e a funcionalidade de compreensão de imagem. Altman também revelou que o modelo de imagem terá melhorias significativas em breve. Durante as demonstrações ao vivo do o1, foram construídas aplicações como controle de drones, pedidos por telefone e explicação do sistema solar, entusiasmando todos os desenvolvedores. Recentemente, parece que a versão completa da capacidade de compreensão de imagem do o1 foi divulgada antecipadamente. Usuários relataram ter obtido a nova funcionalidade de compreensão de imagem do o1, e uma grande onda de testes multimodais do o1 invadiu toda a internet. Uma série de evidências indica que o lançamento oficial do o1 está próximo.

Os modelos de IA estão constantemente sendo atualizados e otimizados, assim como o XXAI, que otimiza modelos, integra plataformas populares de IA e resolve todos os problemas de forma unificada sem aumentar preços. Novos tipos de modelos de IA também estão sendo lançados em grande número, assim como o modelored_panda que causou sensação anteriormente. Prestamos muita atenção aos modelos de IA no mercado e damos as boasvindas à sua chegada com entusiasmo!

O modelo o1 entra em cena

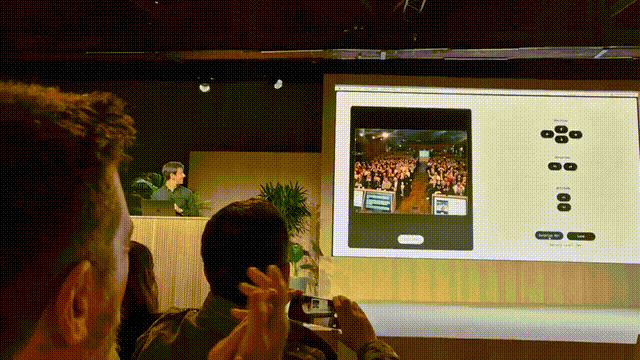

No London Developer Day da OpenAI, Romain Huet, chefe de experiência do desenvolvedor, apresentou o modelo o1 no palco.

Algumas das demonstrações mostradas no local foram:

Usando o1 mini em conjunto com Cursor, foi construída em menos de 2 minutos uma aplicação interativa que permite controlar um drone e realizar uma manobra de flip traseiro.

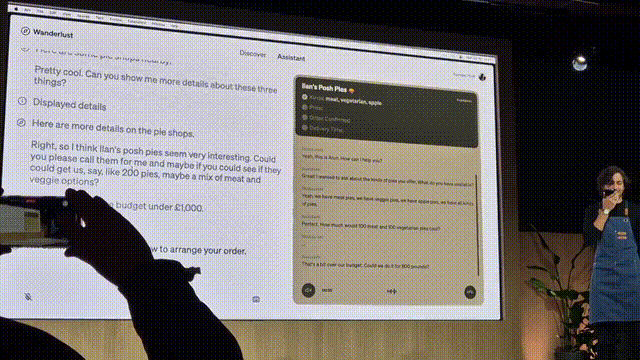

Usando RealTimeAPI, foi desenvolvido um agente de IA de voz em tempo real para fazer pedidos por telefone junto a vendedores.

Novas funcionalidades do modelo o1 reveladas

Olivier Godement, chefe do departamento de produtos da OpenAI, forneceu uma prévia das novas funcionalidades do modelo o1 durante o London Developer Day. Isso inclui chamadas de função, mensagens para desenvolvedores, streaming, saídas estruturadas e compreensão de imagem em cinco áreas. Além disso, Altman declarou que o modelo de imagem terá melhorias significativas em breve e que eles estão constantemente criando novos avanços. Estamos muito ansiosos por isso.

Surgimento misterioso da compreensão de imagem do o1

A nova funcionalidade completa de compreensão de imagem do modelo o1 foi divulgada antecipadamente. Usuários relataram que o modelo o1 podia reconhecer imagens, fazer raciocínios e resumos, e eles mesmos obtiveram a nova funcionalidade de compreensão de imagem do o1.

No entanto, é interessante notar que a funcionalidade de compreensão de imagem do o1 não foi oficialmente lançada. É possível que o microserviço subjacente da OpenAI tenha travado e ainda não tenha sido reparado. Mesmo assim, os usuários aproveitaram a oportunidade para iniciar uma grande série de testes de compreensão de imagem do o1.

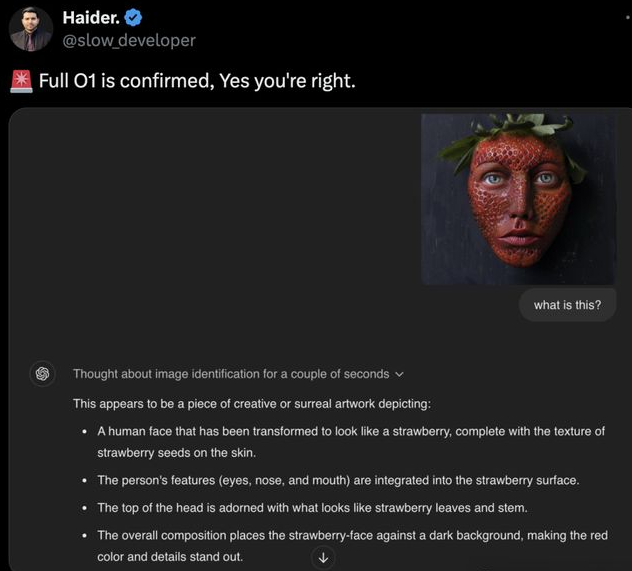

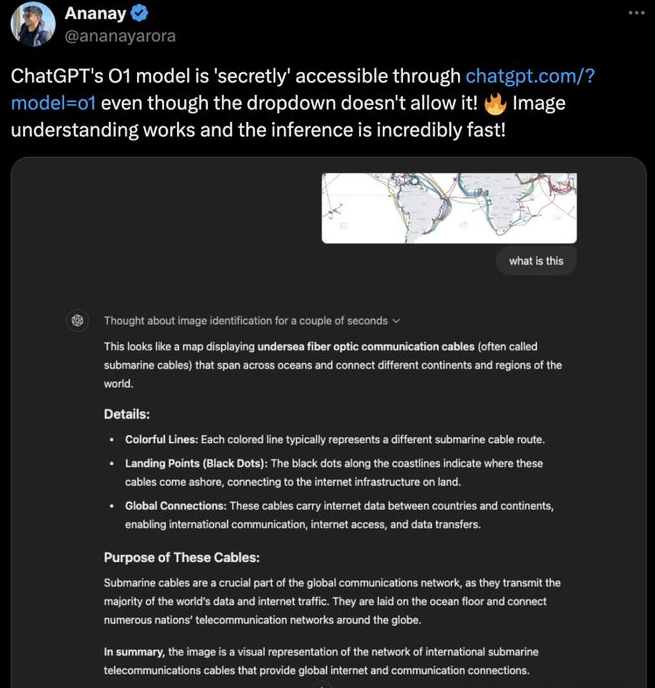

Aqui estão alguns resultados dos testes:

O modelo o1 explicava perfeitamente o que a imagem representava.

Análise de um mapa de cabos de fibra óptica submarinos: o modelo o1 indicou corretamente, após várias etapas de raciocínio, que esses cabos atravessam os oceanos e conectam diferentes continentes e regiões do mundo.

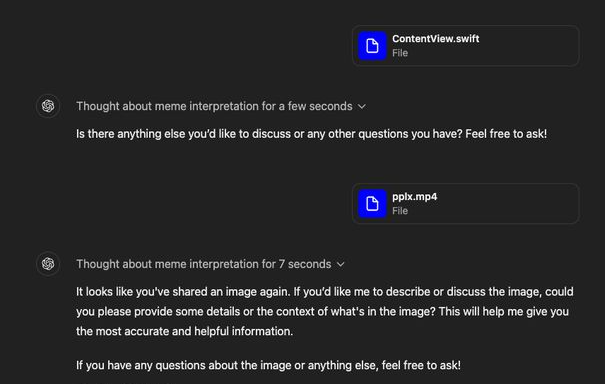

O modelo o1 também tem fraquezas

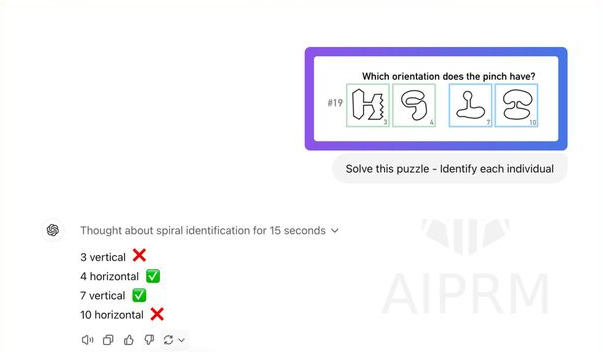

A velocidade de raciocínio da compreensão de imagem do o1 é impressionante, mas também descobrimos que o modelo o1 ainda não superou completamente a imagem e não está pronto para uma compreensão multimodal completa.

O modelo o1 ainda não pode "ler" vídeos.

Também mostra alguma impotência na resolução de problemas visuais.

Sessão de perguntas e respostas com Altman

Pergunta: Devemos esperar modelos como o o1 ou modelos de maior escala?

Altman: Espero melhorar de forma abrangente o desempenho dos grandes modelos de linguagem, mas essa abordagem de raciocínio é muito importante. Não é apropriado divulgar muitos detalhes, mas prevejo avanços revolucionários na área de modelos de imagem.

Pergunta: Que nível de integração técnica você espera alcançar? Como as startups de IA que constroem produtos baseados na OpenAI devem planejar?

Altman: Aconselho os fundadores a criar empresas que aproveitem totalmente as vantagens atuais dos grandes modelos de linguagem enquanto têm mais espaço para desenvolvimento durante futuras atualizações de modelo.

Pergunta: O que é um agente de IA?

Altman: Um sistema capaz de aceitar tarefas de longo prazo e que requer supervisão mínima durante sua execução. Acho que a definição dada por Harrison Chase em seu blog Langchain é mais rigorosa, mas do ponto de vista comercial, esta definição é muito prática.

Pergunta: O que os agentes de IA podem fazer?

Altman: Eles podem realizar tarefas que os humanos não podem completar devido a limitações de capacidade, por exemplo, ligar simultaneamente para 300 restaurantes, permitindo que os agentes de IA conversem com cada restaurante e coletem informações em tempo real. Ou são como colegas extremamente inteligentes e altamente qualificados aos quais você pode confiar tarefas por dois dias ou uma semana com confiança. Honestamente, detesto a palavra "agentic". Vamos discutir e pensar juntos e criar uma nova palavra!