Schwarzer Mythos! Kannst du zwischen echten Videos und von KI generierten Videos unterscheiden?

Während der Nationalfeiertagsferien in diesem Jahr haben einige Internetnutzer die KI-Technologie genutzt, um die Stimme von Lei Jun zu klonen. Dabei äußerten sie Kritik an unhöflichem Verhalten oder brachten Unzufriedenheit gegenüber anderen zum Ausdruck. Einige machten Witze darüber, dass sie „während der gesamten Ferien von der KI Lei Jun verflucht wurden“. In Reaktion darauf veröffentlichte Lei Jun heute ein Video, in dem er mitteilt, dass es ihm tatsächlich unangenehm und unangenehm gewesen ist. Er drückte die Hoffnung aus, dass die Leute damit aufhören, da er es für nicht gut hält, obwohl er weiterhin glaubt, dass KI eine ausgezeichnete und nützliche Technologie ist.

()

Kürzlich nahm ich an einem Test zu KI-Videos teil, und die Ergebnisse haben mich überrascht. Als Content Creator, der sich auf KI spezialisiert hat, habe ich nur 60 Punkte erzielt, als ich versuchte, die Authentizität von zehn Videos zu unterscheiden. Für mich war das ziemlich herausfordernd. Interessanterweise variierten die Punktzahlen meiner Freunde ebenfalls, wobei die höchste nur 90 Punkte betrug. Diese Erfahrung ließ mich erkennen, wie komplex die Technologie zur Erstellung von KI-Videos geworden ist, was die Unterscheidung zwischen einem echten und einem gefälschten Video erschwert.

Die Gefahren von KI-generierten Videos

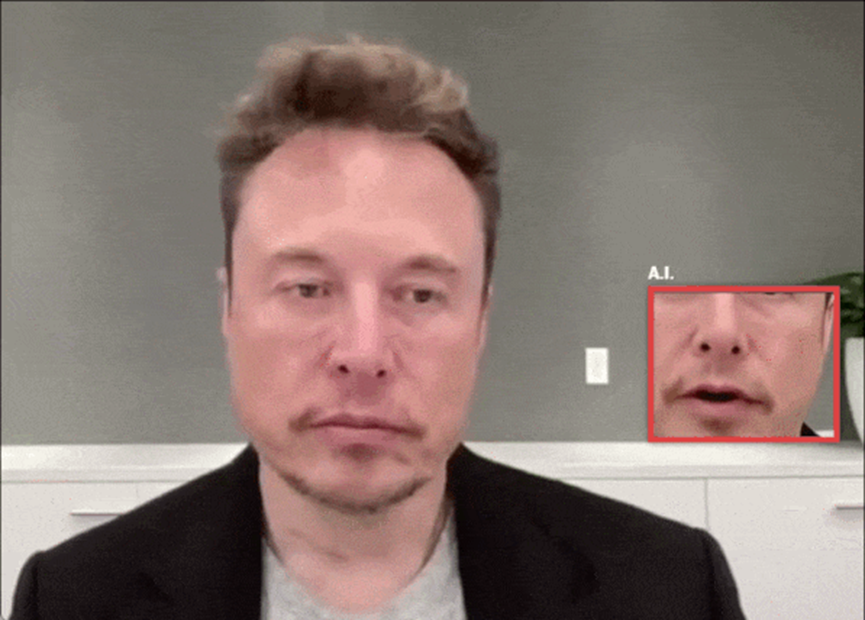

Mit der Verbreitung der KI-Technologie nehmen auch Betrügereien mit gefälschten Videos zu. Beispielsweise wurde berichtet, dass ein 82-jähriger Rentner von einem Unternehmen, das angeblich von einem „KI-Elon Musk“ unterstützt wurde, betrogen wurde und 690.000 Dollar seines gesamten Lebensersparnisses verlor.

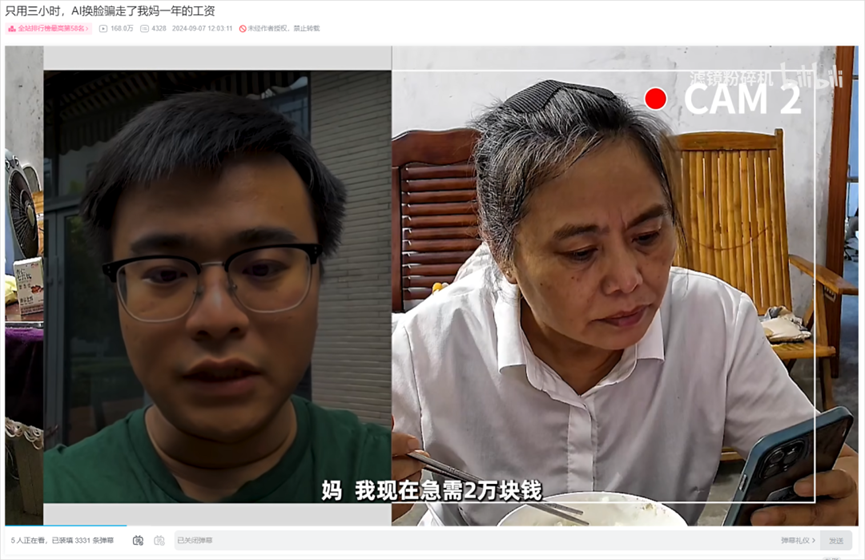

Solche Vorfälle sind online recht häufig. Auf Bilibili hat ein Creator KI-gestützte Lippenbewegungstechnologie verwendet, um seine Mutter zu täuschen, was zu einem Verlust von 20.000 Yuan führte.

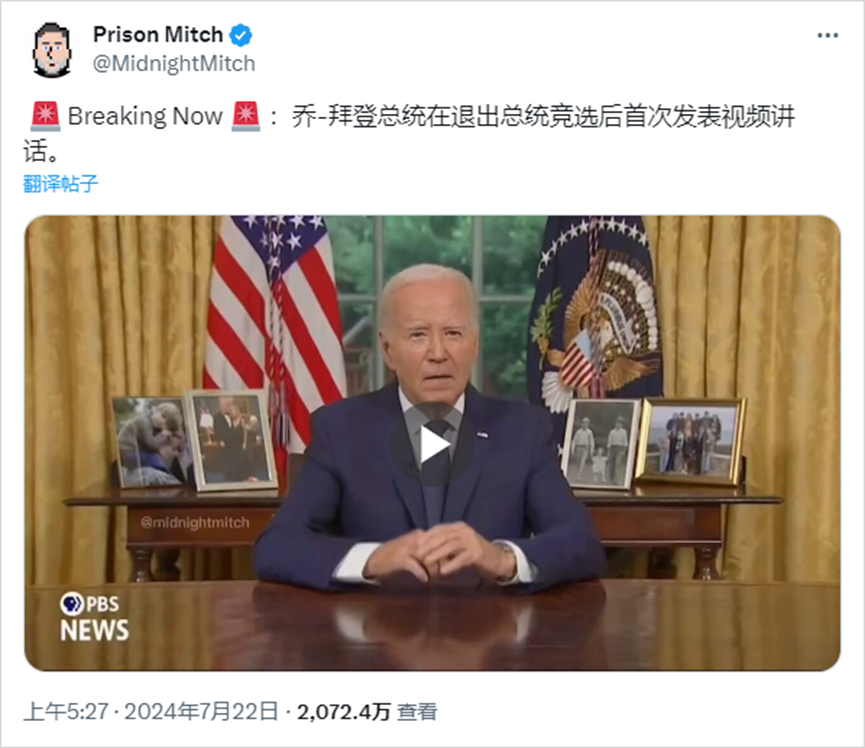

Außerdem wurde ein Video von Biden, das im Juli auf der sozialen Plattform X erschien, ebenfalls als ein gefälschtes KI-Video entlarvt. Obwohl die Enthüllung sowohl Lacher als auch Tränen hervorrief, sind die zugrunde liegenden Sicherheitsrisiken erheblich.

Aktueller Stand der KI-Video-Technologie

Heutzutage ist die Hürde für die Erstellung von KI-Videos nahezu nicht existent. Im vergangenen Jahr herrschte Skepsis gegenüber der Technologie des Gesichtswechsels und der Lippenbewegungen, aber innerhalb eines Jahres sind diese Werkzeuge einfach und effektiv geworden. Normale Benutzer können problemlos realistische Videos erstellen, indem sie einen einfachen Clip in eine App hochladen und Sprachübertragungen hinzufügen. Dieser Trend ist besonders auf Kurzvideo-Plattformen wie Douyin zu beobachten, wo interessante, aber nicht unbedingt vertrauenswürdige KI-Inhalte häufig vorkommen.

Während wir über KI-Videos sprechen, ist es erwähnenswert, dass XXAI sich auf ein episches Update in der nächsten Woche vorbereitet. Dieses Update wird bestehende Funktionen verbessern und beliebte KI-Modelle wie GPT-o1, perplexity, Grok und Gmini hinzufügen, sodass Benutzer verschiedene KI-Funktionen für nur 9,90 Dollar pro Monat ausprobieren können, was diese fortschrittliche Technologie für mehr Menschen zugänglicher macht.

Methoden zur Identifizierung von KI-Videos

Angesichts der Zunahme gefälschter Videos ist es entscheidend, zu lernen, diese zu identifizieren. Ich denke, es gibt zwei einfache und praktische Methoden, die erwähnenswert sind:

Achte auf die Lippen und die Zähne

Stell dir einen Schauspieler vor, der eine Puppenshow macht. Wenn du die Lippen der Puppe in einer Aufnahme beobachtest, kannst du oft feststellen, dass der Bereich um die Lippen verschwommen ist, manchmal begleitet von subtilen Zittern. Mit der aktuellen KI-Technologie kann die Lippenbewegung oft nicht perfekt synchronisiert werden, insbesondere wenn es um die Darstellung der Zähne geht, die häufig dupliziert oder unnatürlich erscheinen können. Achte auf diese Details, um besser zwischen echt und gefälscht unterscheiden zu können.

Achte darauf, ob sich die Bewegungen wiederholen

Diese Methode ist möglicherweise nicht sehr hilfreich für Content-Creator, die ihre Videos häufig aktualisieren, aber sie kann bei vielen 2D-Digitalavatare effektiv sein. Beispielsweise sind KI-Avatare in Interviews oft nur in der Lage, eine Handvoll fester Bewegungen zu wiederholen und zeigen manchmal unangemessene Gesten oder abweichende Blicke. Achte auf diese subtilen Hinweise, um KI-generierte Inhalte zu erkennen, die nicht natürlich wirken.

Fazit

Da die Technologie der KI-generierten Videos reift, werden die Probleme mit gefälschten Videos in den sozialen Medien weiter zunehmen. Das bestehende Rechtssystem hat mit der raschen technologischen Entwicklung nicht Schritt gehalten, was es gewissenlosen Individuen ermöglicht, ungestraft zu handeln. Daher ist es entscheidend, das Verständnis und Wissen der Öffentlichkeit über KI-Technologie zu erhöhen, da dies der Schlüssel ist, um irreführende Informationen zu bekämpfen. Jeder von uns trägt die Verantwortung, sein Identifikationsvermögen zu verbessern. In dieser Ära des schnellen Wandels sollten wir wachsam bleiben, um die Wahrheit zu erkennen und nicht einfach oberflächliche Informationen zu akzeptieren. Sich selbst und andere zu schützen, während wir uns in dieser Technologie bewegen, ist letztendlich wahre Weisheit.