Una panoramica su Gemini 2.0 Flash e Pro e come provarlo gratuitamente

Dopo il rilascio di DeepSeek-R1 e dell'o3-mini di OpenAI, Google ha ufficialmente lanciato l'intera serie di modelli Gemini 2.0. La serie 2.0 "è costruita utilizzando nuove tecnologie di apprendimento per rinforzo, impiegando lo stesso Gemini per criticare le proprie risposte. Ciò ha prodotto feedback più precisi e mirati, migliorando la capacità del modello di gestire input sensibili. La cosa più importante è che questi modelli sono accessibili gratuitamente su Google Studio AI.

Caratteristiche di Gemini 2.0 Flash e Pro

● 2.0 Flash: offre un'interfaccia API progettata appositamente per gli sviluppatori, consentendo la costruzione rapida di applicazioni.

● 2.0 Flash-Lite: raggiunge un migliore rapporto costi-benefici e una maggiore velocità di risposta mantenendo un alto livello di prestazioni.

● 2.0 Flash Thinking Experimental: è disponibile nell'app Gemini per l'esperienza utente.

● 2.0 Pro Experimental: si concentra sulle prestazioni di codifica e sulla capacità di gestire input complessi, mostrando eccellenti prestazioni nella comprensione di conoscenze e nel ragionamento logico.

Funzionalità di Gemini 2.0 Flash e Pro

Gemini 2.0 Flash

Il modello Gemini 2.0 Flash è adatto per compiti su larga scala e ad alta frequenza, in grado di gestire una finestra di contesto fino a 1 milione di token, con potenti capacità di ragionamento multimodale. Il modello Gemini 2.0 Flash può interagire con applicazioni come YouTube, Google Search e Google Maps, aiutando gli utenti a scoprire e ampliare le proprie conoscenze in vari scenari applicativi. Queste applicazioni connesse hanno fatto dell'app Gemini un assistente IA unico e utile.

Gemini 2.0 Flash-Lite

Il modello 2.0 Flash-Lite supporta una finestra di contesto di 1 milione di token e input multimodali, oltre a funzionalità di base come output di testo e chiamate a funzioni. Attualmente, non supporta API multimodali in tempo reale, strumenti di ricerca e esecuzione di codice. Questo modello è ottimizzato per casi d'uso di output di testo su larga scala e ha superato 1.5 Flash nella maggior parte dei test benchmark, mantenendo velocità e costi apprezzati dagli sviluppatori.

Gemini 2.0 Flash Thinking Experimental

Il modello 2.0 Flash Thinking Experimental supporta una finestra di contesto di 1 milione di token, consentendo un'analisi più approfondita dei testi lunghi. Migliora non solo la velocità e le prestazioni, ma si distingue anche nelle aree della scienza e della matematica. Ha capacità di ragionamento per risolvere problemi complessi.

Il modello Gemini 2.0 Flash Thinking si basa sulla velocità e sulle prestazioni di 2.0 Flash, ed è stato addestrato a scomporre i prompt in una serie di passaggi, rafforzando le sue capacità di ragionamento e fornendo risposte di maggiore qualità.

Il modello 2.0 Flash Thinking Experimental dimostra il proprio processo di pensiero, consentendo agli utenti di vedere perché risponde in un certo modo, quali sono le sue assunzioni e di seguire la logica del ragionamento del modello. Questa trasparenza consente agli utenti di comprendere meglio il processo decisionale del modello.

Gemini 2.0 Pro Experimental

Il modello 2.0 Pro Experimental è esperto in programmazione e può rispondere a input complessi. Questo modello ha una finestra di contesto di 2 milioni di token e supporta input in testo, immagini, video e audio. Può analizzare e comprendere grandi quantità di informazioni in modo globale e supporta l'invocazione di strumenti come Google Search e l'esecuzione di codice.

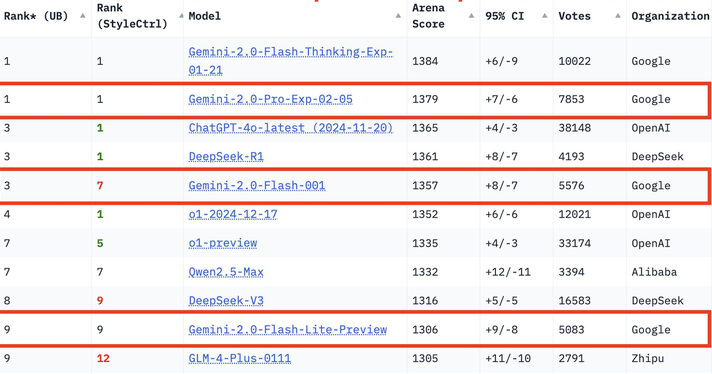

Risultati dei test di prestazione della serie Gemini 2.0

Nell'ultima arena di grandi modelli, Gemini-2.0-Pro si classifica al primo posto in tutte le categorie, Gemini-2.0-Flash si classifica al terzo posto e Flash-lite si posiziona tra i primi dieci grazie al suo eccellente rapporto costo-prestazioni.

Nel test MMLU-Pro, il 2.0 Pro Experimental ha ottenuto un punteggio del 79,1%, mentre il 2.0 Flash Lite Preview e il 2.0 Flash GA hanno ottenuto punteggi rispettivamente del 71,6% e 77,6%.

In termini di generazione di codice, matematica e abilità multilingue, il 2.0 Pro Experimental mostra anch'esso prestazioni eccellenti, con punteggi eccezionali in matematica (91,8%) e abilità multilingue (86,5%).

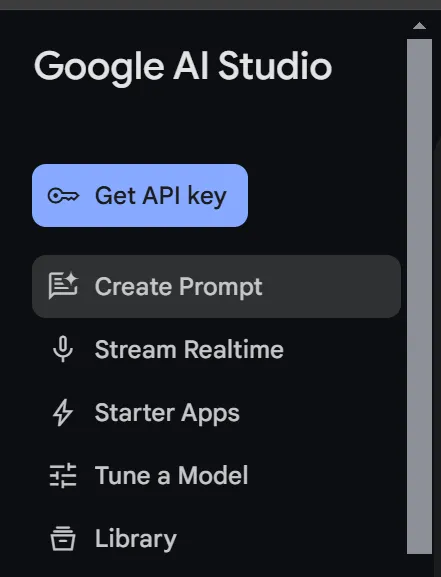

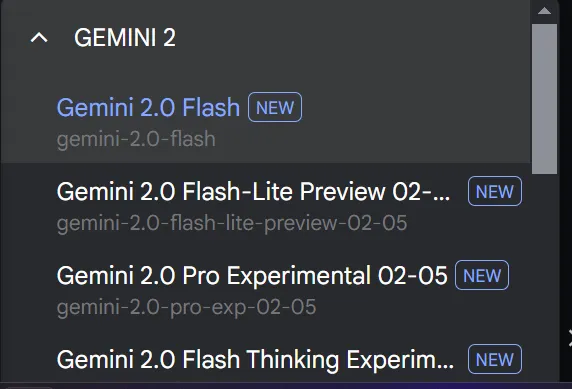

Come utilizzare gratuitamente i modelli Google Gemini 2.0 Flash e Pro?

- Accedi a Google AI Studio.

- Vai a creare prompt.

- Scegli il modello che preferisci.

- Inizia la chat.

XXAI rimane aggiornato, ottimizza e migliora le prestazioni

toolpilot.ai offre agli utenti un'esperienza di servizio di alta qualità e verifica rigorosamente ogni strumento di IA. L'offerta di strumenti di IA nel sito viene costantemente arricchita, consentendo agli utenti di trovare tutti gli strumenti di IA necessari su una sola piattaforma. XXAI ha completato un ciclo di aggiornamenti per offrire un'esperienza di servizio di qualità.

Questo aggiornamento ha aggiunto tre funzionalità importanti.

Funzione di ricerca web: applicabile a tutti i modelli XXAI, supporta la ricerca di informazioni in tempo reale su Internet, fornendo accesso ai dati più recenti, garantendo l'accuratezza e la tempestività delle risposte, oltre a includere una funzione di validazione delle informazioni.

Funzione di pensiero: offre capacità di analisi avanzate simili a quelle del modello Gemini 2.0 Flash Thinking, supporta ragionamenti approfonditi, risolve problemi complessi e simula modelli di pensiero umano.

Ricerca nella cronologia delle chat: consente di cercare facilmente tutte le conversazioni di chat precedenti, facilitando il ritrovamento di informazioni specifiche da interazioni passate.

Con questo aggiornamento, XXAI ti offre risposte più complete, analisi più profonde, informazioni più accurate e una migliore esperienza utente.